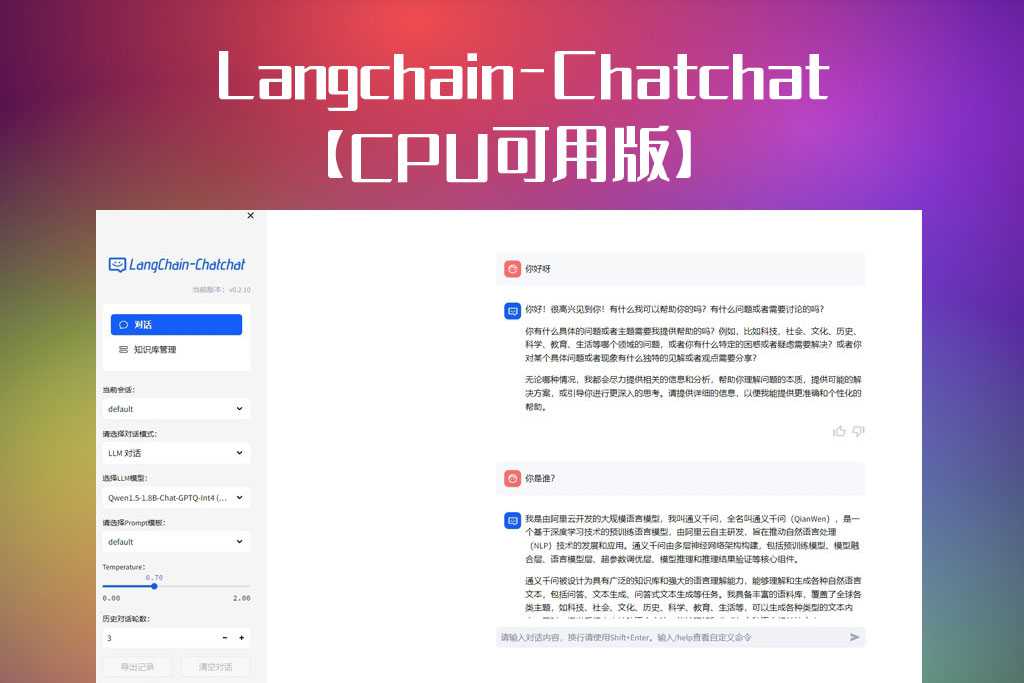

Langchain-Chatchat+Qwen 介绍

Langchain-Chatchat是一个基于本地知识库的问答应用,它利用了langchain的思想来实现。以下是对Langchain-Chatchat的详细介绍:

项目目标:

建立一套对中文场景与开源模型支持友好、可离线运行的知识库问答解决方案。

项目特点:

依托于支持的开源LLM(大语言模型)与Embedding模型,可实现全部使用开源模型进行离线私有部署。

支持OpenAIGPT API的调用,并将在后续持续扩充对各类模型及模型API的接入。

硬件要求(以顺畅运行某些模型为例):

ChatGLM3-6B 最低显存要求为12GB,3060就可以

LLaMA3 至少需要16G显卡可用。

Qwen 无需显卡,CPU可用。

对于更大的模型,如Qwen-14B-Chat等14B模型,最低显存要求为30GB,推荐显卡为V100。

支持模型:

支持多款主流LLMs,如ChatGLM-2、LLaMA-2等。

支持多款embedding模型,如m3e等。

部署方式:

Langchain-Chatchat提供多种部署方式,包括通过AutoDL云平台、Docker镜像进行部署,也支持本地部署。

官网提供了详细的安装步骤和配置指南,方便用户根据自身需求选择合适的部署方式。

对于小白用户,我们提供了一件启动包。

应用场景与优势:

Langchain-Chatchat适用于需要私有化部署、数据安全保护及私域化服务的企业或个人。

其优势在于支持本地化运行,无需依赖外部网络服务,同时提供了灵活的配置选项和扩展性,可以满足不同场景下的需求。

Langchain-Chatchat是一个功能强大且灵活的本地知识库问答应用解决方案,它结合了多种开源模型和技术来实现高效、安全的本地化问答服务。

Langchain-Chatchat+Qwen 硬件及系统要求

系统:win10或win11系统,不支持win7及以下系统

内存:16以上

显卡:无需显卡,cpu可用

安装方法

一键安装,无需安装复杂环境。解压即用!

使用说明

解压安装包,必须解压至D盘根目录。

本工具,具体的教程请在导航栏-AI教程-工具教程中查看!

1、一键安装,无需安装复杂环境。解压即用!

2、本地知识库支持的文件类型(HTML,MD,JSON,JSONL,CSV,PDF,PNG,JPG, JPEG,BMP,EML,EPUB,XLSX,XLSD, PY,RST, RTF,SRTTSV,DOCX.DOC,XML,PPT.PPTX.TXT.HTM)

3、部署完成后,可能通Qwen向自己的本地知识库提出相应问题的答案,再结合Qwen输出让人满意的答案

下载说明:公众号搜索:“AI软件合集”,回复:“验证码”,获取查看下载地址及解压密码!

注意:本站汇聚全网顶级AI工具,全站内容仅对VIP开放;非VIP,下载后不能正常运行。

运行说明:先运行授权工具,登录VIP账号密码,然后运行即可。

注意:工具类直接运行,文档类需安装WPS,视频类需安装PotPlayer。